研究者の執筆作業を丸ごと自動化

研究論文の執筆は、実験が終わってからが本番です。データを整理し、図表を作成し、関連研究を調べ、何度も推敲する。この作業に数週間から数ヶ月かかることも珍しくありません。

Google Cloud AI Researchが発表したPaperOrchestraは、この執筆プロセス全体を自動化するシステムです。研究者が用意するのは、実験後の粗いメモ(構想要約)と実験ログだけ。あとはシステムが投稿可能な完成論文を生成してくれます。処理時間は平均39.6分、APIコールは60〜70回程度です。

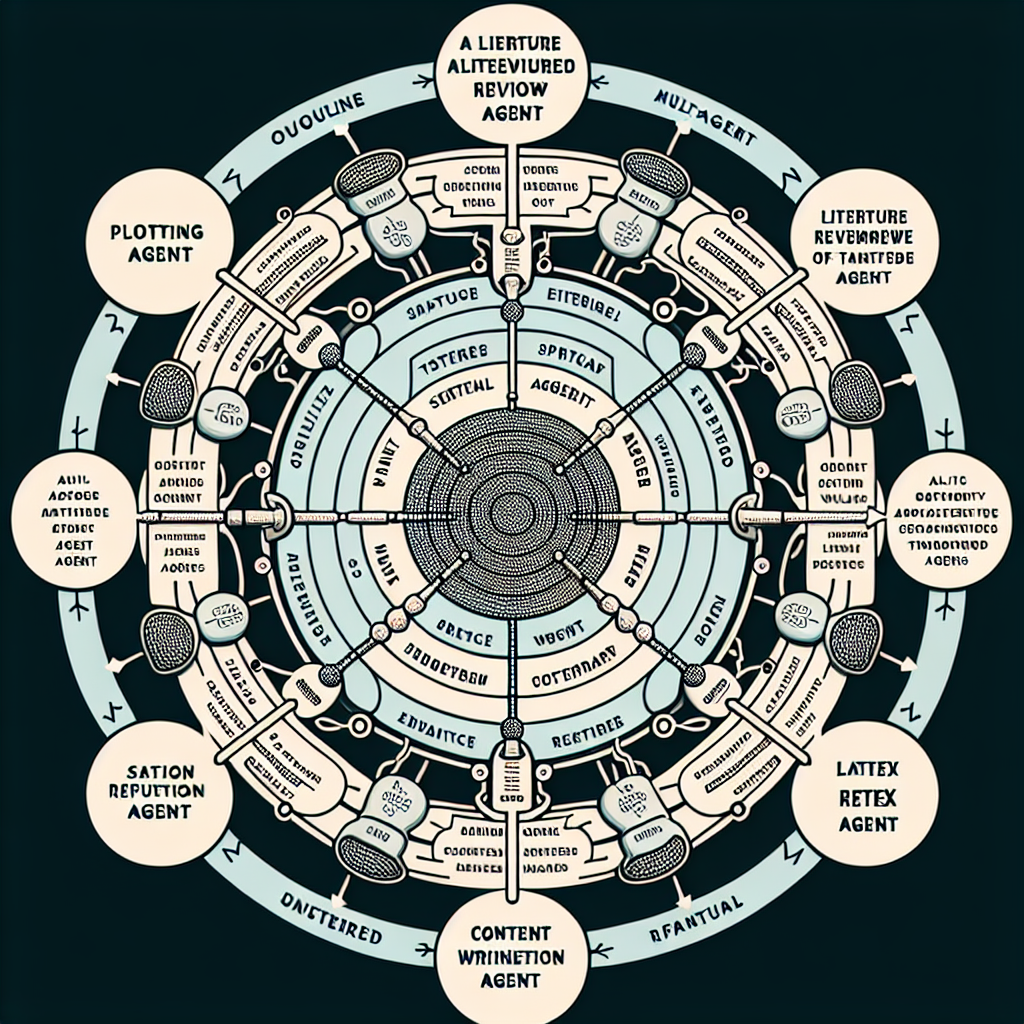

このシステムの特徴は、5つの専門エージェントが分業する点にあります。人間の研究チームのように、それぞれが得意分野を担当して協力します。

5つの専門エージェントが協力する仕組み

PaperOrchestraは、論文執筆の各工程を5つのAIエージェントに分担させています。

最初に動くのがOutline Agentです。粗い構想メモと実験ログ、LaTeXテンプレートから、論文の構造化されたアウトラインを作成します。どのセクションに何を書くか、全体の設計図を描く役割です。

次にPlotting Agentが図表を生成します。PaperBananaという学術図表ツールを使い、Vision-Language Modelが批評しながら反復修正していきます。実験データを視覚化する作業を自動化できるのは、研究者にとって大きな時短になるでしょう。

Literature Review Agentは文献調査を担当します。Web検索とSemantic Scholar APIを使い、関連論文を探して引用を検証。論文1本あたり平均45〜48件の文献を引用します(人間執筆は約59件)。収集した文献の最低90%を実際に引用するという制約を設けることで、引用の網羅性を確保しています。

Section Writing Agentは、抽象、手法、実験、結論といった各セクションを執筆します。そして最後にContent Refinement Agentが、AgentReviewという模擬査読システムを使って論文を反復的に改善していきます。

査読通過レベルの品質を実現

PaperOrchestraの性能は、実際の学会基準で評価されています。CVPR(コンピュータビジョンの主要学会)の模擬受理率は84%、ICLR(機械学習の主要学会)では81%でした。人間執筆論文の受理率はCVPRで86%、ICLRで94%なので、完全に同等とは言えませんが、かなり近い水準です。

既存の類似システムと比較すると、PaperOrchestraの優位性が明確になります。AI Scientist-v2に対して39〜86%の勝率、単一エージェントシステムに対しては52〜88%の勝率を記録しました。

特に興味深いのは、Content Refinement Agent(査読対応エージェント)の効果です。洗練前の論文と比較して79〜81%の勝率を示し、CVPR受理率を19%、ICLR受理率を22%向上させました。査読コメントに対応して論文を改善する作業も、AIが代行できるわけです。

非構造化データから完成論文を生成できる唯一のツール

PaperOrchestraの最大の強みは、非構造化データを扱える点にあります。既存システムの多くは、事前に整理されたBibTeXファイルや、特定のフォーマットに従った入力を必要としました。

例えばCyclerResearcherは、事前構造化されたBibTeXファイルが必須です。AutoSurvey2やLiRAは文献レビューに優れていますが、特定の新手法を先行研究と比較する「関連研究」セクションを書けません。AI Scientistは自動実験と執筆を実行できますが、内部実験パイプラインに密結合しており、ユーザー独自のデータには対応できません。

PaperOrchestraは、研究者が実際に持っている粗いメモと散在するデータから、完全な論文を生成できる唯一のシステムだと開発チームは主張しています。実験ノートをそのまま渡せば論文になる、というのは研究者にとって理想的な環境でしょう。

初の標準化ベンチマークも公開

PaperOrchestraの発表と同時に、PaperWritingBenchという標準化ベンチマークも公開されました。これは論文自動執筆システムを評価するための初の共通基準です。

ベンチマークはCVPR 2025とICLR 2025の受理論文200件(各100件)で構成されています。各論文について、Sparse Idea Summary(高概念的な記述のみ)とDense Idea Summary(数式やLaTeXを含む詳細記述)の2つの入力設定が用意されています。

評価の結果、Dense設定の方が全体品質で優れていました(43〜56%の勝率)。ただし文献レビュー品質については、SparseとDenseでほぼ同等(各32〜40%、28〜39%)という結果でした。詳細な構想メモがあれば論文全体の質は上がるものの、文献調査の質はメモの詳しさにあまり依存しないようです。

人間評価では課題も

11名のAI研究者による人間評価も実施されました。180件のペア比較を通じて、PaperOrchestraと他システムを比較しています。

文献レビュー品質では、PaperOrchestraが50〜68%の絶対勝率を示しました。これは高い評価と言えます。しかし全体原稿品質になると、勝率は14〜38%に下がります。人間執筆論文との文献統合比較でも、タイまたは勝利となったのは43%でした。

また、自律的に生成された図表は、人間が作成した図表と比べると情報量が少ない傾向があります。それでも、図表生成機能を有効にした場合(PlotOn)は、無効の場合(PlotOff)と比較して51〜66%のタイ/勝率を記録しています。

実験データの改ざんはできない設計

PaperOrchestraには重要な制限事項があります。実験ログに存在しないデータは生成できません。つまり、実験結果を都合よく改ざんしたり、存在しないデータを捏造したりすることは不可能です。

これは倫理的に重要な設計です。論文執筆を自動化しても、科学的誠実性は保たれます。システムはあくまで執筆作業を支援するだけで、実験結果そのものには手を加えません。

フリーランスへの影響

PaperOrchestraは研究者向けツールですが、フリーランスのライターやコンテンツ制作者にとっても重要な示唆があります。

まず、専門文書の自動生成技術が急速に進化している点です。論文という高度に専門的な文書を、粗いメモから40分で生成できるなら、ホワイトペーパーや技術レポート、調査報告書といった文書の自動化も時間の問題でしょう。これらの文書制作で収入を得ているライターは、今後数年で競争環境が変わる可能性があります。

一方で、人間評価の結果は希望も示しています。文献レビューは高品質でも、全体原稿品質では人間に及ばない。これは、構成力や文章の流れ、読者への配慮といった人間的な要素が、まだAIには難しいことを意味します。

また、PaperOrchestraの5エージェント構成は、コンテンツ制作ワークフローの参考になります。調査、構成、執筆、編集といった工程を分けて、それぞれに適したAIツールを組み合わせる。このアプローチは、フリーランスの作業効率化にも応用できそうです。

まとめ

PaperOrchestraは、専門文書の自動生成技術が実用レベルに達したことを示す事例です。研究者向けツールなので、すぐにフリーランスの実務に使えるわけではありません。ただし、この技術の進化速度を見ておくことは重要でしょう。

特にホワイトペーパーや技術文書の制作に携わっている方は、今後1〜2年で同様のツールが登場する可能性を想定しておくと良いかもしれません。今のうちに、AIでは代替しにくい付加価値(クライアントとの関係構築、戦略的な提案、独自の視点など)を強化しておくことをお勧めします。

詳細は論文(https://arxiv.org/pdf/2604.05018)とプロジェクトページ(https://yiwen-song.github.io/paper_orchestra/)で確認できます。

コメント