AIの処理を分散させる新しい仕組み

大規模な言語モデルを動かすとき、特に長い文章を処理する場合、膨大な計算リソースが必要になります。これまでは一つのデータセンター内で全ての処理を完結させるのが一般的でした。しかし、Moonshot AIと清華大学が提案したPrfaaS(Prefill-as-a-Service)は、この常識を変える可能性があります。

PrfaaSの核心的なアイデアは、AIの推論処理を二つの段階に分けることです。まず、入力された文章を理解する「プリフィル」という処理を、計算能力の高い専用のデータセンターで行います。次に、その結果を別のデータセンターに送り、そこで文章を生成する「デコード」処理を実行します。この二段階の分離により、それぞれの処理に最適なハードウェアを使えるようになりました。

実験では、プリフィル用にNVIDIAのH200 GPUを32個、デコード用にH20 GPUを64個使用した構成で、従来の均質な構成と比べて54%も高い処理速度を達成しています。さらに、ハードウェアコストを同じにした場合でも約15%の性能向上が見られました。

ネットワーク負荷を劇的に削減する技術

データセンター間でデータをやり取りする際、ネットワークの帯域幅が大きな課題になります。特にAIの処理では、KVキャッシュと呼ばれる大量のデータを転送する必要があり、これがボトルネックになりがちです。

PrfaaSでは、ハイブリッド注意アーキテクチャという技術を採用することで、このKVキャッシュのサイズを約36分の1まで圧縮しています。例えば、内部で使用された1Tパラメータのモデルでは、32,000トークンの処理でも約3.19 Gbpsのネットワーク帯域幅で済みます。これは、現代のデータセンター間接続で十分に対応可能な範囲です。

実際の運用では、利用可能なネットワーク帯域幅のわずか13%しか使用していません。つまり、既存のネットワークインフラをほとんど変更せずに導入できる可能性があります。

どのように動作するのか

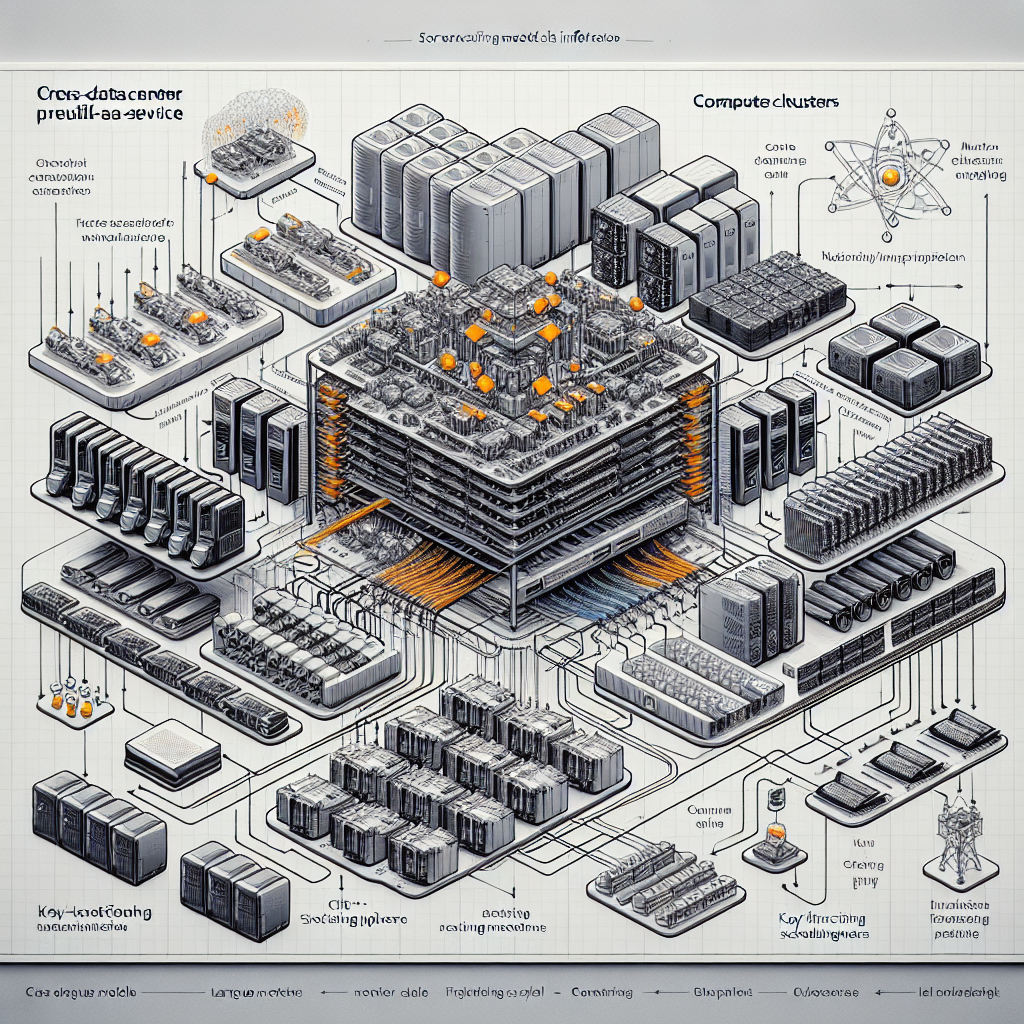

PrfaaSは三つの主要なサブシステムで構成されています。一つ目は計算リソースで、ローカルのデータセンターとプリフィル専用のデータセンターを組み合わせます。二つ目はネットワークで、データセンター内では高速なRDMAを使い、データセンター間では商用のEthernetを使用します。三つ目はストレージで、異なる種類のキャッシュデータを効率的に管理します。

システムは、処理する文章の長さに応じて自動的にルーティングを行います。例えば、実験では約19,400トークン以上の長い文章はプリフィル専用のデータセンターに送られ、それより短い文章はローカルで処理されました。この閾値は、全体の約50%のリクエストが振り分けられるように調整されています。

さらに、システムは二つの時間スケールで最適化を行います。短期的には、リアルタイムでネットワークの混雑状況を監視し、ルーティングを調整します。長期的には、トラフィックパターンの変化に応じて、各データセンターのリソース配分を自動的に再調整します。

レスポンス時間も大幅に改善

処理速度だけでなく、ユーザーが最初の応答を受け取るまでの時間(TTFT)も重要な指標です。PrfaaSでは、平均のTTFTが50%削減され、90パーセンタイル値では64%も削減されています。これは、ユーザー体験の大幅な改善を意味します。

興味深いのは、単にハードウェアを混在させるだけでは十分な効果が得られないという点です。実験では、プリフィルとデコードを分離するだけでスケジューリングロジックを持たない構成も試されましたが、性能向上は16%にとどまりました。PrfaaSの完全なシステムでは54%の向上が見られたことから、インテリジェントなルーティングとスケジューリングが重要な役割を果たしていることがわかります。

スケーラビリティの展望

研究チームは、この技術が大規模な環境でも機能することを予測しています。例えば、10,000個のGPUを持つデータセンターでも、KVキャッシュの転送に必要な帯域幅は約1.8 Tbpsで、現代のデータセンター間接続の容量内に収まります。

この技術が特に効果を発揮するのは、Kimi Linear、MiMo-V2-Flash、Qwen3.5-397B、Ring-2.5-1Tといったハイブリッド注意アーキテクチャを採用したモデルです。これらのモデルは、線形複雑度の注意層と完全注意層を交互に配置することで、メモリ効率を高めています。

研究チームは、PrfaaSを「近い将来のコンセプト」ではなく、現在のハイブリッドアーキテクチャモデル向けに実行可能な設計だと強調しています。文脈窓がさらに拡大し、KVキャッシュ圧縮技術が成熟し、NVIDIA Rubinのような特化したハードウェアが広く利用可能になれば、この分散型アプローチの重要性はさらに高まるでしょう。

フリーランスにとっての意味

この技術は、直接的にはAIインフラを運営する企業向けのものですが、フリーランスにも間接的な影響があります。まず、AIサービスのコストが下がれば、私たちが利用するAPIの料金も将来的に低下する可能性があります。長文を扱うAIサービスが、より手頃な価格で利用できるようになるかもしれません。

また、自分でAIサービスを立ち上げることを考えている方にとっては、初期投資を抑えられる選択肢になります。全てのハードウェアを一箇所に集める必要がなくなれば、段階的にインフラを拡張していくことが可能になります。クラウドサービスを利用している場合も、複数のデータセンターを組み合わせることで、コストと性能のバランスを最適化できるかもしれません。

特に、長文の文書解析やレポート生成、コンテンツ制作支援といった用途でAIを活用している方は、処理速度の向上とコスト削減の恩恵を受けやすいでしょう。ただし、この技術が主要なAIサービスプロバイダーに採用され、実際に料金や性能に反映されるまでには時間がかかると考えられます。

まとめ

PrfaaSは、AIの推論処理を分散化する新しいアプローチです。現時点では研究段階ですが、既存のネットワークインフラで動作可能な設計になっており、実用化のハードルは比較的低いと言えます。フリーランスとしては、この技術が主要なAIサービスにどのように組み込まれていくかを注視しつつ、長文処理が必要な案件では、将来的なコスト削減の可能性を念頭に置いておくとよいでしょう。今すぐ何かアクションを起こす必要はありませんが、AIインフラの進化が私たちの仕事環境にどう影響するかを理解しておくことは、長期的な戦略を立てる上で役立ちます。

参考:MarkTechPost

コメント