Transformer Engineとは何か

NVIDIA Transformer Engineは、深層学習モデルの訓練を高速化するためのライブラリです。GitHubで公開されており、誰でも無料で利用できます。

このツールの最大の特徴は「混合精度訓練」に対応している点です。通常、AIモデルの訓練では32ビット浮動小数点数(FP32)を使いますが、Transformer Engineでは8ビット浮動小数点数(FP8)や16ビット(BF16)といった低精度の数値形式を組み合わせて計算します。精度を落とすことで計算速度が上がり、GPUのメモリ消費も抑えられます。

技術系ブログのMarktechpostが公開したチュートリアルでは、Python環境でTransformer Engineを実装する手順が詳しく解説されています。特にGoogle Colabでの動作を想定しており、個人のフリーランスエンジニアでも手軽に試せる内容になっています。

実際の実装内容

チュートリアルでは、まず環境設定から始まります。使用しているGPUがCUDAに対応しているか、FP8やBF16といった低精度計算に対応しているかを確認するコードが用意されています。Transformer Engineの利点を最大限に活かすには、これらの機能に対応したGPUが必要です。

次に、実際のモデル構築に進みます。チュートリアルでは「ティーチャーモデル」と「スチューデントネットワーク」という2つのモデルを用意し、知識蒸留という手法を使って学習させます。ティーチャーモデルは大きなモデルで、その知識を小さなスチューデントモデルに移すという仕組みです。

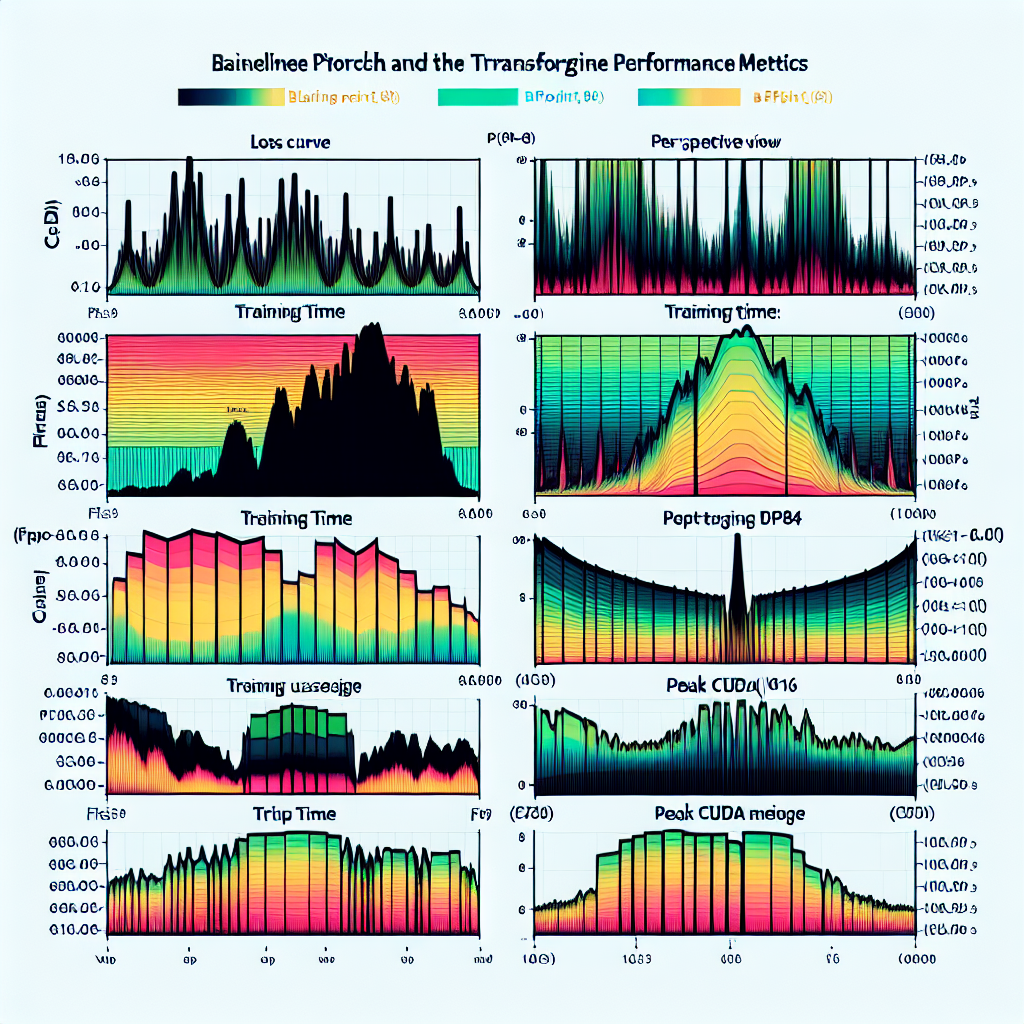

興味深いのは、同じモデル構造を「通常のPyTorch」と「Transformer Engine対応版」の2パターンで実装している点です。両者を比較することで、Transformer Engineの効果を数値で確認できます。例えば、訓練速度やメモリ使用量がどれくらい改善されるかを、実際のベンチマーク結果として可視化できます。

具体的な設定値

チュートリアルで使われている設定は以下の通りです。隠れ層のサイズは512、中間層は2048、レイヤー数は3層という比較的小規模なモデルです。バッチサイズは8で、25ステップの訓練を行います。学習率は0.0002、重み減衰は0.01という標準的な値が設定されています。

これらの数値は、個人のフリーランスが試す際の参考になります。より大きなモデルや長時間の訓練を行う場合は、設定を調整する必要があります。

技術的な仕組み

Transformer Engineの核心は「DelayedScaling」というレシピです。これは、訓練中に数値の精度を動的に調整する仕組みで、モデルの精度を保ちながら計算を高速化します。チュートリアルではFP8形式のE4M3という形式を使用しており、これは8ビットのうち4ビットを指数部、3ビットを仮数部に割り当てる形式です。

実装では、通常のPyTorchの層を「te.LayerNorm」や「te.Linear」といったTransformer Engine専用の層に置き換えます。また、PyTorchの「autocast」という自動混合精度機能と組み合わせることで、さらなる最適化が可能になります。

技術的には複雑に聞こえるかもしれませんが、実際のコードはシンプルです。既存のPyTorchコードに数行追加するだけで、混合精度訓練の恩恵を受けられます。

実際の使用例

例えば、あなたがフリーランスでAIチャットボットの開発を請け負っているとします。クライアントから「応答速度を改善したい」という要望があり、モデルの再訓練が必要になったとしましょう。

通常のPyTorchで訓練すると、GPU付きのColab環境でも数時間かかる作業が、Transformer Engineを使うことで大幅に短縮できる可能性があります。チュートリアルのベンチマークでは、訓練速度やメモリ効率の改善が確認されており、限られた計算リソースでより多くの実験を回せるようになります。

別の例として、画像認識モデルの開発を考えてみましょう。大量の画像データで訓練する際、メモリ不足でバッチサイズを小さくせざるを得ない場面がよくあります。Transformer Engineの低精度計算を活用すれば、同じGPUでもより大きなバッチサイズで訓練でき、結果的に学習の安定性が向上します。

環境の互換性問題

チュートリアルでは、実用的な配慮がされています。Colab環境では、nvccコンパイラやcuDNNヘッダーが使えない場合があります。本来、Transformer EngineのPyTorch拡張を構築するにはこれらが必要ですが、チュートリアルではこうした制約がある環境でも動作するようなフォールバック処理が組み込まれています。

ただし、FP8のような最新の低精度フォーマットを使うには、対応したGPUハードウェアが必要です。古いGPUでは、BF16までしか使えない可能性があります。それでも、通常のFP32訓練よりは高速化の恩恵を受けられます。

フリーランスへの影響

このツールは、AI開発を仕事にしているフリーランスにとって実用的な選択肢になります。特に、クライアントワークで「できるだけ早くプロトタイプを作りたい」という場面では、訓練時間の短縮が直接的な価値になります。

例えば、複数のモデル候補を試す必要がある案件では、1つのモデルの訓練時間が半分になれば、同じ期限内に2倍の実験を回せます。これは提案の質を高めることにつながり、結果的にクライアントの満足度向上や追加案件の獲得につながる可能性があります。

また、個人で運営するAIサービスのコスト削減にも役立ちます。クラウドGPUの利用時間が減れば、それだけ運営コストが下がります。月額20ドルのGPUインスタンスを使っている場合、訓練時間が半分になれば月10ドルの節約になる計算です。

ただし、導入には学習コストがかかります。チュートリアルは丁寧に書かれていますが、PyTorchの基礎知識は必要です。また、すべてのモデルで劇的な効果が出るわけではありません。Transformerベースのアーキテクチャで最も効果を発揮するため、畳み込みニューラルネットワーク(CNN)中心の案件では恩恵が限定的かもしれません。

まとめ

NVIDIA Transformer Engineは、AI開発の効率化を目指すフリーランスにとって試す価値のあるツールです。特にGoogle Colabで手軽に試せる点は、初期投資なしで効果を確認できる大きなメリットです。

すでにPyTorchでAIモデルの開発をしている方は、GitHubのチュートリアルコードを実際に動かしてみることをお勧めします。ベンチマーク結果を見て、自分の案件に適用できそうか判断すると良いでしょう。一方、AI開発の経験がまだ浅い方や、Transformerを使わない案件が中心の方は、今すぐ導入する必要はありません。技術の成熟を見守りながら、必要になったタイミングで学ぶという選択肢もあります。

コメント