クラウドに頼らず、自分のPCでAIモデルを育てる時代

AIモデルのファインチューニングといえば、これまでは高価なクラウドサービスか、数百万円規模のGPUクラスタが必要でした。個人やフリーランスが独自のAIモデルを育てるには、技術的にもコスト的にもハードルが高かったのが現実です。

Unsloth AIが発表した「Unsloth Studio」は、この状況を大きく変える可能性があります。OpenAIのTriton言語で最適化された独自のカーネルを採用することで、従来の学習フレームワークと比べてVRAM使用量を70%削減し、学習速度を2倍に高めました。これにより、通常は複数のハイエンドGPUが必要だった70億パラメータクラスのモデルを、RTX 4090やRTX 5090といった一般ユーザー向けGPU一枚で学習できるようになっています。

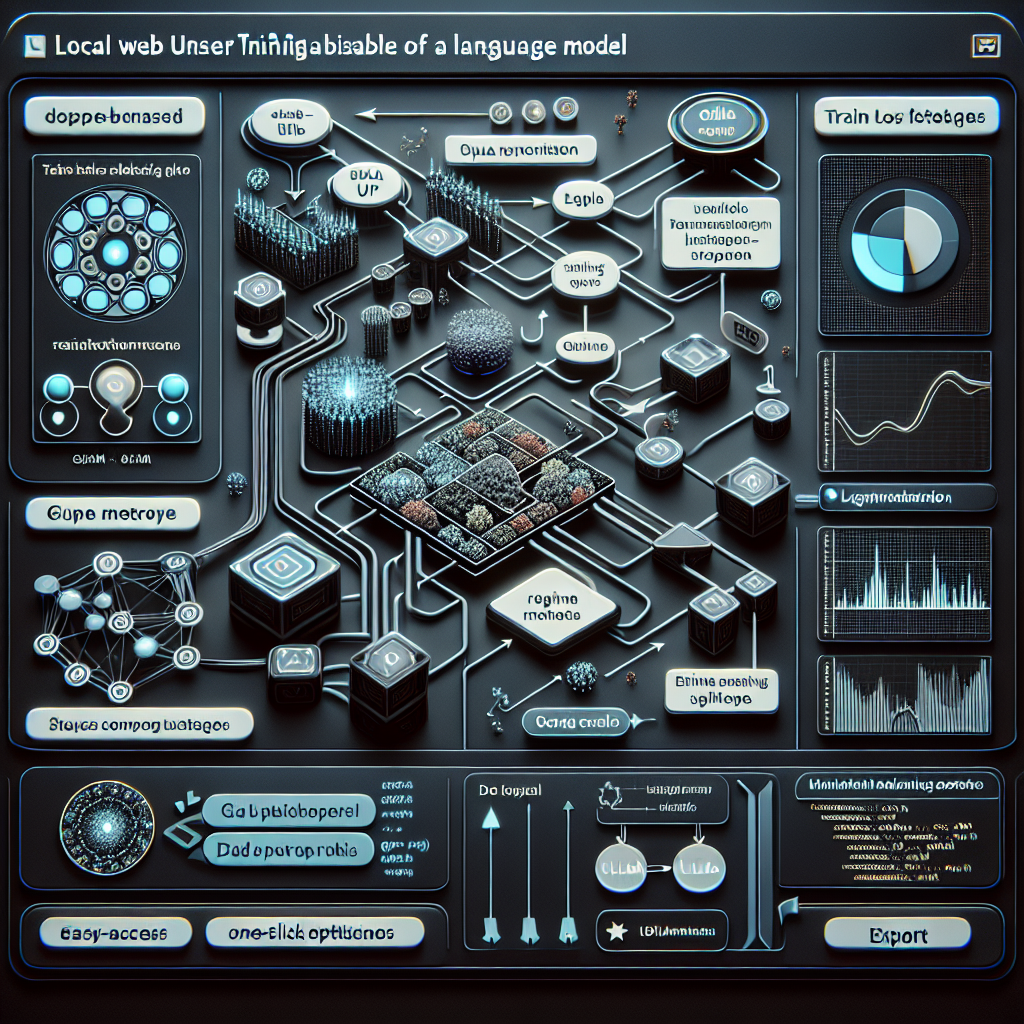

しかも、ノーコードのWebインターフェースを備えているため、Pythonのコードを書かなくてもデータの準備から学習、デプロイまでの全工程を視覚的に操作できます。WindowsとLinuxの両方に対応しており、ローカル環境で完結するため、クラウドサービスへの月額課金も不要です。

データ準備からデプロイまで、すべてブラウザで完結

Unsloth Studioの最大の魅力は、LLMファインチューニングのライフサイクル全体を一つのインターフェースで管理できる点です。「Data Recipes」という機能では、ノードベースのビジュアルワークフローでデータの取り込みと変換を処理します。PDFやDOCX、JSONL、CSVといった一般的なファイル形式をアップロードするだけで、学習用データセットを準備できます。

特に便利なのが、NVIDIAのDataDesignerを活用した合成データ生成機能です。たとえば、非構造化の業務文書をアップロードすると、自動的に構造化されたインストラクションフォローデータセットに変換してくれます。フリーランスのライターなら自分の過去記事を、デザイナーならプロジェクトの仕様書を学習データに変換し、自分の仕事スタイルを反映したAIアシスタントを作ることも可能です。

学習中は、リアルタイムで損失曲線やシステムメトリクスを監視できます。従来は学習が完了するまで結果が分からず、失敗した場合は時間とコストが無駄になることがありましたが、Unsloth Studioでは途中経過を見ながら学習パラメータを調整できます。

学習が完了したら、用途に応じて3つの形式でエクスポートできます。GGUFはローカルのCPUやGPUで推論を実行する場合、vLLMは高スループットの本番環境向け、Ollamaはローカルテストに適しています。それぞれワンクリックで変換できるため、デプロイ先に応じてフォーマットを変更する手間がかかりません。

推論AIモデルの学習も、一般的なGPUで可能に

Unsloth Studioは、最近注目を集めている推論AI(Reasoning AI)モデルの学習にも対応しています。推論AIとは、多段階の論理展開や数学的証明が可能なモデルで、DeepSeek-R1などが代表例です。従来の強化学習手法であるPPO(Proximal Policy Optimization)では、Criticモデルという別のモデルが必要で、VRAM消費が大きくなる課題がありました。

Unsloth StudioはGRPO(グループ相対ポリシー最適化)という新しい強化学習技術に対応しています。GRPOはグループ出力の相対報酬を計算する方式のため、別途Criticモデルが不要で、VRAM消費を抑えながら推論AIモデルを学習できます。これにより、ローカルハードウェア上で推論AIモデルのファインチューニングが現実的になりました。

対応モデルも豊富で、Llama 3.1、Llama 3.3、DeepSeek-R1、Llama 4シリーズ、Qwen 2.5/3.5といった主要なオープンソースモデルを学習できます。特に8億パラメータと70億パラメータのモデルに特化しており、コンシューマーグレードのGPUでも実用的なファインチューニングが可能です。

量子化で更にメモリを節約

Unsloth Studioは4ビットと8ビットの量子化にも対応しています。量子化とは、モデルの重みを低精度の数値で表現することでメモリ使用量を削減する技術です。LoRAやQLoRAといったPEFT(Parameter-Efficient Fine-Tuning)技術と組み合わせることで、モデル全体を更新するのではなく、一部のパラメータだけを効率的に調整します。

たとえば、70億パラメータのモデルを4ビット量子化でファインチューニングする場合、通常の16ビット学習と比べてVRAM使用量を大幅に削減できます。精度の損失も最小限に抑えられるため、限られたハードウェアリソースで実用的なモデルを育てることができます。

フリーランスにとっての現実的な選択肢になるか

Unsloth Studioの登場は、フリーランスや小規模事業者にとって、独自AIモデルの開発が現実的な選択肢になる可能性を示しています。これまでクラウドサービスに月数万円を支払うか、諦めるかの二択だった状況が、オープンソースのローカルツールで解決できるようになりました。

特に恩恵を受けそうなのは、クライアントワークで特定の業務パターンを繰り返している方です。たとえば、特定業界の記事執筆を多く手がけるライターなら、過去記事を学習させて業界用語や文体を反映したアシスタントを作れます。デザイナーなら、プロジェクトの仕様書やフィードバック履歴を学習させて、クライアントの要望を先回りして理解するツールに仕上げることも考えられます。

ただし、ハードルがないわけではありません。RTX 4090クラスのGPUは20万円前後の投資が必要ですし、ファインチューニングの基本的な知識も求められます。ノーコードとはいえ、どのデータを用意すべきか、どのパラメータを調整すべきかは、ある程度の学習が必要です。また、学習には時間もかかります。モデルのサイズやデータセットの規模によっては、数時間から数日かかることもあります。

それでも、クラウドサービスに継続的にコストをかけ続けるよりは、初期投資でハードウェアを揃えてしまう方が、長期的にはコストを抑えられる可能性があります。特に、データのプライバシーを重視する業務や、オフライン環境での作業が必要な場合は、ローカルで完結できるメリットは大きいでしょう。

今すぐ試すべきか、それとも様子見か

Unsloth Studioは、独自のAIモデルを育ててみたいと考えている方にとって、試してみる価値のあるツールです。特に、既にRTX 4090クラスのGPUを持っている方や、クラウドサービスのコストに悩んでいる方は、すぐに導入を検討しても良いでしょう。オープンソースなので、まずは小規模なデータセットで試してみて、効果を確認してから本格的に活用する流れがおすすめです。

一方、GPUを持っていない方や、ファインチューニングの必要性がまだ明確でない方は、もう少し様子を見ても良いかもしれません。今後、さらに使いやすいツールが登場する可能性もありますし、ハードウェアの価格も変動します。まずはChatGPTやClaudeといった既存のサービスで十分かどうかを見極めてから、独自モデルの開発に進むのが現実的です。

いずれにせよ、AIモデルのファインチューニングが個人レベルで手の届く範囲に入ってきたことは、大きな変化です。今後、フリーランスが自分専用のAIアシスタントを持つことが、特別なことではなくなる日も近いかもしれません。

参考リンク:MarkTechPost

コメント