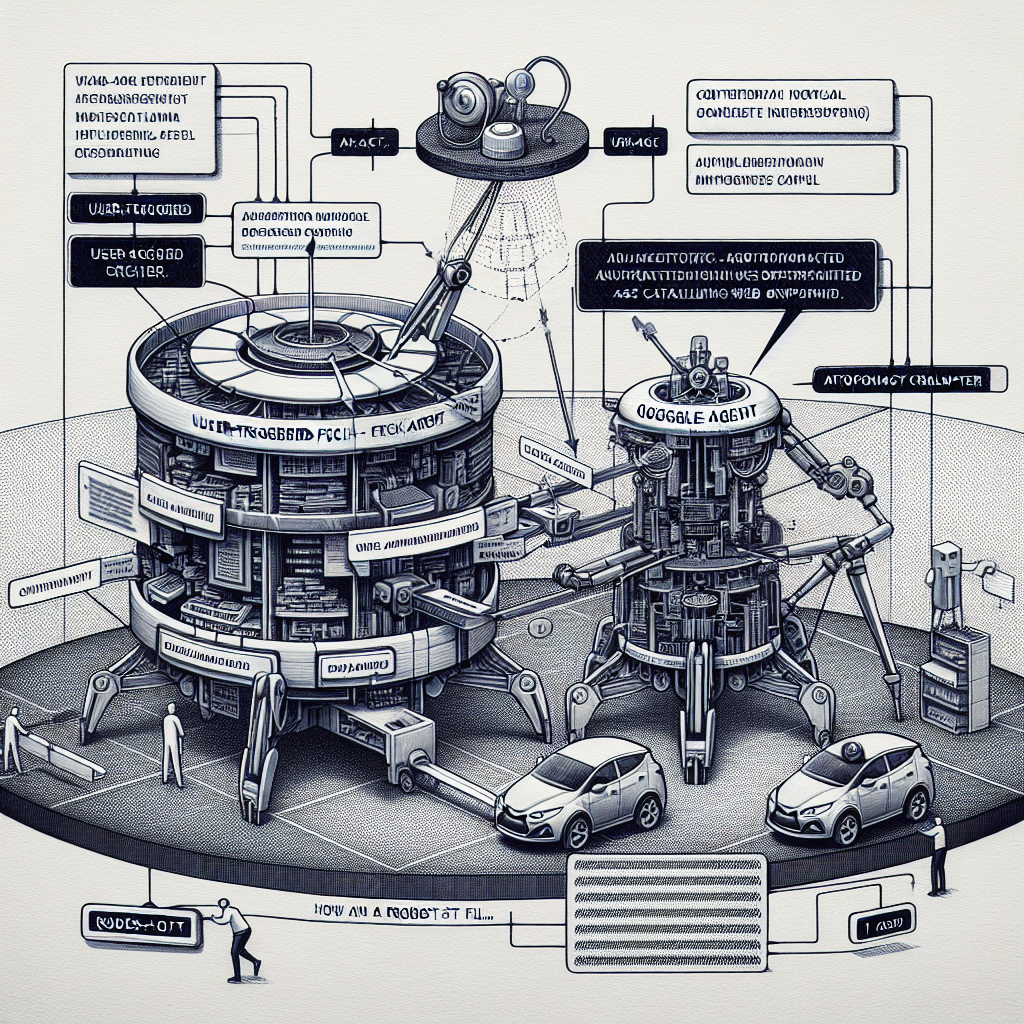

Google-Agentとは何か

Google-Agentは、Googleの各種AI製品に統合された新しい技術的な仕組みです。GeminiなどのAIツールを使っているユーザーが、特定のウェブページの情報を求めたときに、そのコンテンツを取得するために動作します。

これまでのGooglebotは、定期的にウェブサイトを巡回してインデックスを作成する「自律型クローラー」でした。対照的に、Google-Agentは「ユーザートリガー型」です。つまり、AIツールのユーザーが明示的にリクエストを出したときだけ、該当するURLにアクセスします。

技術的には、User-Agent文字列で識別できます。具体的には「Google-Agent」というトークンが含まれており、サーバーログを見れば通常のブラウザやクローラーと区別できます。

従来のクローラーとの決定的な違い

Google-Agentの最も大きな特徴は、robots.txtを無視することです。これはGoogle公式ドキュメントにも明記されています。

robots.txtは、ウェブサイトの運営者が「このページはクローラーに見せたくない」と指定するためのファイルです。多くのサイト運営者がSEO対策やプライバシー保護のために使ってきました。しかし、Google-Agentはこのルールをスルーします。

理由は明確です。Google-Agentは、ユーザーのプロキシとして動作するからです。ユーザーがブラウザで直接アクセスできるページなら、AIツールを通じてもアクセスできるべきだ、というGoogleの判断があります。

もう一つの違いは、リンクをたどって新しいページを発見する機能がないことです。Googlebotは「このページにリンクがあるから、次はこっちも見てみよう」と自律的に動きますが、Google-Agentはユーザーが指定したURLだけを取得します。

トラフィックパターンの変化

通常のクローラーは、Googleのインデックス更新スケジュールに従って定期的にアクセスします。しかし、Google-Agentのトラフィックは、そのコンテンツがAIツールのユーザーの間でどれだけ人気かに連動します。

たとえば、あなたが運営するブログ記事が突然AIツールの回答によく引用されるようになると、Google-Agentからのアクセスが急増する可能性があります。逆に、定期的なクローラーアクセスは少なくても、ユーザー需要に応じてバースト的にトラフィックが発生するかもしれません。

フリーランスのサイト運営者への影響

この変化は、自分のウェブサイトやポートフォリオサイトを持つフリーランスにとって、いくつかの実務的な課題をもたらします。

アクセス制御の見直しが必要

これまでrobots.txtで「このページはクローラーに見せない」と設定していた部分が、Google-Agentには効きません。会員限定コンテンツや下書きページなど、公開したくない情報がある場合は、認証やサーバーサイドの権限設定で制御する必要があります。

具体的には、Basic認証やログイン機能、IPアドレス制限などの方法です。robots.txtだけに頼っていた場合は、セキュリティ設定を見直すタイミングかもしれません。

WAFやレート制限の調整

ファイアウォールやセキュリティツールで「ボットは全部ブロック」という設定にしていると、Google-Agentもブロックしてしまう可能性があります。そうなると、GoogleのAIツールを使っているユーザーがあなたのコンテンツにアクセスできなくなります。

Google-AgentのUser-Agent文字列を許可リストに追加するか、Googleの公開IPレンジを使って検証する方法があります。ただし、Google-Agentは予測可能なIP範囲に限定されない可能性もあるため、User-Agent文字列での識別が推奨されます。

サーバー負荷への備え

コンテンツがAIツールでよく参照されるようになると、予期しないタイミングでトラフィックが急増することがあります。特に、バズったコンテンツや専門性の高い情報を発信している場合は要注意です。

共有サーバーを使っているフリーランスの方は、急なアクセス増加に対応できるか確認しておくと安心です。負荷分散やキャッシュ設定を見直すのも一つの方法です。

誰にとって重要な変化か

この変化が特に影響するのは、次のようなフリーランスの方です。

まず、自社サイトやブログを運営していて、技術的な管理を自分で行っている方。robots.txtでアクセス制御をしていた場合、設定の見直しが必要になります。

次に、会員制コンテンツや有料記事を提供している方。認証なしでrobots.txtだけに頼っていた場合、意図しない形でコンテンツがAIツールに取得される可能性があります。

また、Webインフラやセキュリティ設定を仕事にしている方にとっては、クライアントへの説明や対応が求められる場面が出てくるかもしれません。

逆に、WordPressなどのCMSで一般的な設定のまま運営していて、特にアクセス制限をしていない方は、すぐに対応が必要というわけではありません。

これからのウェブアクセス管理

GoogleはこのGoogle-Agentの導入を通じて、ウェブとAIの関係を再定義しようとしています。robots.txtという20年以上使われてきたプロトコルが、AI時代には十分に機能しないという判断です。

今後は、User-Agent文字列による正確な識別と、「これはユーザーが起動したリクエストだ」という理解が、サイト管理の新しい標準になっていくでしょう。

フリーランスとしてウェブサイトを運営している方にとって、これは技術的な知識のアップデートが求められる変化です。ただし、焦って全てを変える必要はありません。自分のサイトにアクセス制限が必要な部分があるかを確認し、必要なら段階的に対応していく姿勢で十分です。

まとめ:様子を見ながら対応を

Google-Agentは、すでにサーバーログに現れ始めています。もし自分のサイトのログを確認できる環境にあるなら、一度チェックしてみるといいでしょう。

すぐに対応が必要なのは、robots.txtで重要な情報を保護していた方です。認証やサーバーサイドの設定に切り替えることを検討してください。それ以外の方は、この変化を把握しておき、今後のサイト設計の参考にする程度で問題ありません。

詳細な技術仕様はGoogleの公式ドキュメントで確認できます。エンジニアリングに詳しくない場合は、契約しているホスティングサービスのサポートに相談するのも一つの方法です。

コメント