AIエージェントの「記憶喪失」問題

ChatGPTやClaudeを使っていて、「前に話した内容を覚えていてくれたらいいのに」と思ったことはありませんか。現在の多くのAIツールは、会話をリセットすると過去のやり取りを完全に忘れてしまいます。一部のサービスには会話履歴機能がありますが、それも限定的です。

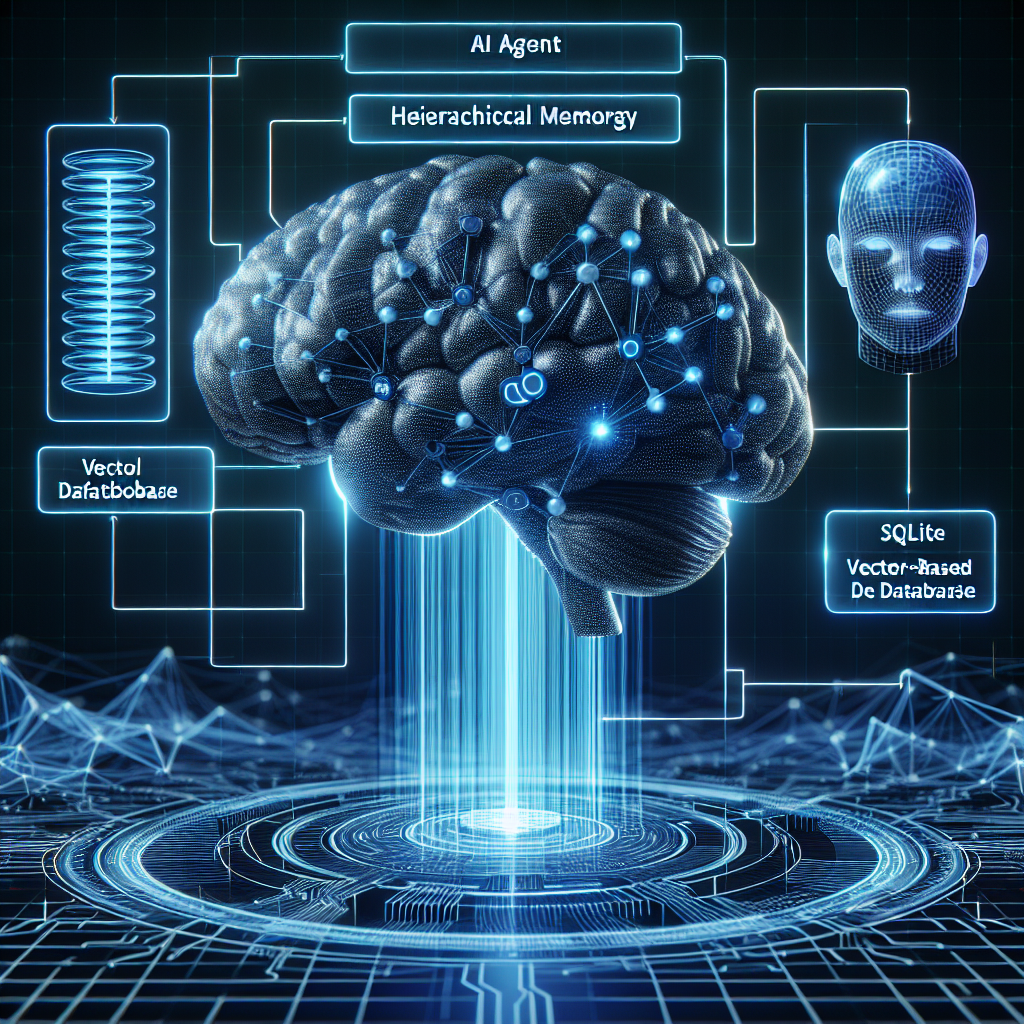

MarkTechPostが2026年3月4日に公開したチュートリアルでは、この問題を根本から解決する方法が紹介されています。人間の脳のように短期記憶と長期記憶を使い分け、重要な情報を永続的に保存し続けるAIエージェントを自作できる仕組みです。

階層型メモリシステムの仕組み

このシステムの核心は「階層型メモリ」という考え方です。人間が日常の些細なことは忘れても、重要な出来事は長期記憶として残すように、AIも情報を階層化して管理します。

短期記憶には最近の会話内容が一時的に保存されます。これはすぐにアクセスできる代わりに、容量に限りがあります。一方、長期記憶には繰り返し参照される情報や重要なデータが移されます。たとえば、あなたが「毎週金曜日にレポートを作成する」とAIに伝えたとします。この情報は長期記憶に保存され、数週間後でも「そろそろ金曜日のレポートですね」と自然に参照できるようになります。

技術的には、FAISSというFacebookが開発したベクター検索ライブラリと、SQLiteという軽量データベースを組み合わせています。FAISSは膨大なデータの中から類似した情報を高速で探し出す役割を担い、SQLiteは情報のメタデータ(日付、カテゴリ、重要度など)を永続的に保存します。

自動メモリ統合機能

このシステムの特徴的な点は、記憶の整理が自動で行われることです。人間が寝ている間に記憶が整理されるように、AIも定期的に短期記憶を見直し、重要な情報を長期記憶に移動させます。

たとえば、クライアントAとの会話で「納品は毎月5日」という情報が3回出てきたとします。システムはこのパターンを検出し、自動的に長期記憶として固定します。次回からは「今月の納品日は?」と聞かれたときに、過去の会話履歴を全部検索しなくても、長期記憶から瞬時に答えられます。

既存ツールとの違い

LangChainなどのフレームワークにも記憶機能はありますが、このEvermemスタイルの手法はより細かい制御が可能です。LangChainは便利な反面、内部の動作がブラックボックス化しており、記憶の優先順位や保存期間を細かく調整しにくい側面があります。

一方、FAISSとSQLiteを直接統合するこの方法では、「どの情報をいつまで保存するか」「どれくらいの頻度でメモリを統合するか」といった設定を完全にコントロールできます。また、GPU加速にも対応しているため、大量のデータを扱う場合でも高速に動作します。

ただし、その分セットアップの手間は増えます。FAISSのインストールやインデックスのトレーニングなど、ある程度の技術的知識が必要です。LangChainのように「すぐに動くサンプル」を期待すると、少し戸惑うかもしれません。

フリーランスにとっての実用性

この技術は主にAI開発者向けですが、フリーランスのエンジニアやデータサイエンティストにとっては新しい提案の材料になります。

たとえば、複数のクライアントを抱えているコンサルタントの場合、それぞれのクライアント専用のAIアシスタントを構築できます。クライアントAとの過去の議論、好みのレポート形式、注意すべきポイントなどを記憶し続けるエージェントがあれば、毎回過去のメールを検索する手間が省けます。

ライティングやマーケティングの分野でも応用できます。特定のブランドのトンマナ、過去に好評だった記事のパターン、避けるべき表現などを長期記憶として蓄積すれば、AIが一貫性のあるコンテンツを生成しやすくなります。

ただし、実装には数日から数週間の学習時間が必要です。Pythonの基礎知識、ベクトルデータベースの概念、RAG(Retrieval-Augmented Generation)の仕組みをある程度理解していないと、チュートリアルを読んでもピンとこない可能性があります。すでにAI関連のプロジェクトを手がけたことがある方なら、比較的スムーズに進められるでしょう。

導入を検討する際の注意点

この手法を実務に取り入れる前に、いくつか確認しておくべき点があります。

まず、FAISSのインストールです。環境によっては依存関係の解決に時間がかかることがあります。特にWindows環境では追加の設定が必要になる場合があります。Mac M1/M2チップでも、一部のバージョンでは互換性の問題が報告されています。

次に、インデックスのトレーニングです。FAISSは事前に大量のデータでインデックスを訓練する必要があります。扱うデータが少ない段階では、検索精度が十分に出ないことがあります。最低でも数百件のデータがないと、長期記憶の恩恵を実感しにくいでしょう。

また、記事では触れられていませんが、日本語対応についても確認が必要です。FAISSは多言語対応ですが、使用する埋め込みモデル(テキストをベクトルに変換するAI)が日本語に最適化されていないと、検索精度が落ちる可能性があります。OpenAIのtext-embedding-3やGoogleのGecko埋め込みモデルなど、日本語に強いモデルを選ぶ必要があります。

今後の展望

永続的な記憶を持つAIエージェントは、今後さらに重要性を増すでしょう。OpenAIやAnthropicなどの大手も、長期記憶機能の強化に取り組んでいますが、完全にカスタマイズ可能なオープンソースの手法は、特定の業務に特化したツールを作りたいフリーランスにとって貴重な選択肢です。

特に、機密性の高いクライアント情報を外部サービスに預けたくない場合、自前でメモリシステムを構築できるメリットは大きいです。すべてのデータをローカル環境やプライベートクラウドで管理できるため、セキュリティ要件の厳しいプロジェクトでも採用しやすくなります。

まとめ

AIエージェントに永続的な記憶を持たせるEvermem手法は、技術的なハードルはあるものの、カスタムAIツールを開発したいフリーランスにとって有力な選択肢です。すでにPythonとAIの基礎知識がある方は、週末に試してみる価値があります。一方、まだAI開発の経験が浅い方は、まずLangChainなどのフレームワークで基本を学んでから取り組むほうがスムーズでしょう。

詳しいチュートリアルは、元記事で公開されています。実際のコード例やステップバイステップの解説が含まれているため、興味のある方は一度目を通してみてください。

参考リンク: MarkTechPost – How to Build an Evermem-Style Persistent AI Agent OS

コメント