Webスクレイピングの新しい選択肢

Webから情報を集める作業は、フリーランスにとって避けて通れないタスクです。競合サイトの価格調査、業界ニュースの収集、クライアント向けのマーケットリサーチなど、手作業でやると驚くほど時間がかかります。

Crawl4AI v0.8は、こうした作業を自動化するためのPythonライブラリです。特筆すべきは、LLM(大規模言語モデル)なしでも構造化されたデータを抽出できる点。従来のスクレイピングツールは、HTMLから目的のデータを取り出すために複雑なコードを書く必要がありましたが、このツールはもう少しシンプルなアプローチを提供しています。

主要な機能とできること

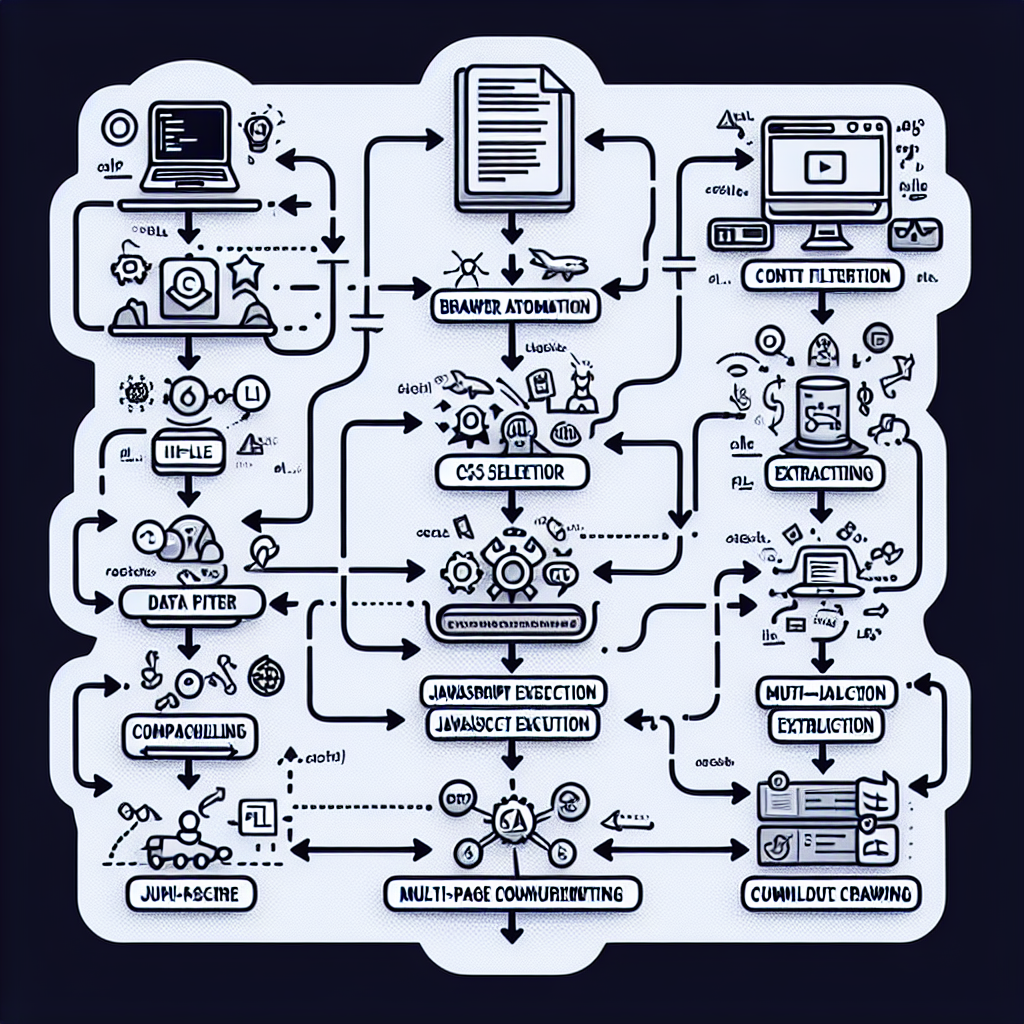

Crawl4AIは、基本的なページ取得から高度なデータ抽出まで、幅広い機能を備えています。

最もシンプルな使い方は、AsyncWebCrawlerを使った基本的なページ取得です。特定のURLにアクセスして、ページ全体をマークダウン形式で保存できます。これだけでも、複数のWebページを一括でテキスト化したい場合に便利です。

より実用的なのが、CSS抽出戦略を使った方法です。例えば、Hacker Newsのようなニュースサイトから、記事のタイトル、URL、投稿者名を自動で抽出できます。JsonCssExtractionStrategyという機能を使えば、CSSセレクタを指定するだけで、LLMを使わずに構造化されたJSONデータとして取得可能です。

さらに高度な使い方として、BM25というアルゴリズムを使ったコンテンツフィルタリングがあります。「AI」「機械学習」といったキーワードに関連する部分だけを抽出することで、不要な情報を削ぎ落とせます。長い記事から必要な箇所だけを取り出したいときに役立ちます。

JavaScriptが動的に生成するコンテンツにも対応しています。ページ読み込み後にスクロールが必要なサイトや、ボタンクリックで表示される情報も取得できます。実際のブラウザを操作するように動作するため、SPAサイトのスクレイピングも可能です。

LLMとの組み合わせも選択できる

必要に応じて、OpenAIのGPT-4oやローカルで動くOllamaと連携することもできます。LLMExtractionStrategyを使えば、Pydanticというライブラリでデータ構造を定義し、AIに「この形式で情報を抽出して」と指示できます。HTMLの構造が複雑で、CSSセレクタだけでは対応が難しい場合に有効です。

ただし、LLMを使う場合はAPI利用料がかかります。OpenAIのAPIを使うなら、処理量に応じてコストが発生するため、大量のページをスクレイピングする際は注意が必要です。一方、CSSベースの抽出なら追加コストはかかりません。

複数ページの同時処理と深いクローリング

Crawl4AIは、複数のURLを並行してクロールする機能も備えています。arun_manyというメソッドを使えば、10個、20個のURLを同時に処理できるため、競合サイトの価格比較や複数メディアのニュース収集が一気に終わります。

さらに、BFSDeepCrawlStrategyという機能を使うと、特定のドメイン内を自動で巡回できます。例えば、企業の採用ページ全体から求人情報を収集したり、ECサイトの商品ページを一括取得したりといった使い方が可能です。深さの制限やURLパターンのフィルタリングもできるため、無駄なページを巡回せずに済みます。

フリーランスへの影響

このツールが最も恩恵をもたらすのは、リサーチ業務や情報収集が多いフリーランスです。ライターなら、複数のニュースサイトから特定トピックの記事を自動収集できます。マーケターなら、競合の価格変動を定期的に監視する仕組みを作れます。

ただし、Pythonの基礎知識は必要です。完全なノーコードツールではないため、コードを書いた経験がない方にはハードルが高いかもしれません。とはいえ、チュートリアルが充実しているため、基本的なPythonの知識があれば、数時間で使い始められるでしょう。

作業時間への影響は大きいです。手作業で30分かかっていた情報収集が、スクリプトを一度書けば数分で終わるようになります。定期的に同じ作業を繰り返している場合、自動化による時短効果は計り知れません。

一方で、Webスクレイピングには法的・倫理的な注意点があります。利用規約でスクレイピングを禁止しているサイトもあるため、使用前に確認が必要です。また、過度なアクセスでサーバーに負荷をかけないよう、リクエスト間隔の調整も重要です。

まとめ

Crawl4AI v0.8は、Webからの情報収集を効率化したいフリーランスにとって有力な選択肢です。LLMなしでも構造化データを抽出できる点が最大の強みで、コストを抑えながら自動化を進められます。

Pythonに多少の知識がある方なら、公式のチュートリアルを読んで試してみる価値があります。一方、プログラミング経験がほとんどない場合は、まずPythonの基礎を学んでからの方がスムーズでしょう。情報収集の頻度が高く、時間を削減したい方には、学習コストをかけても十分にリターンが見込めるツールです。

参考リンク:Crawl4AI公式チュートリアル

コメント