知識蒸留とは何か

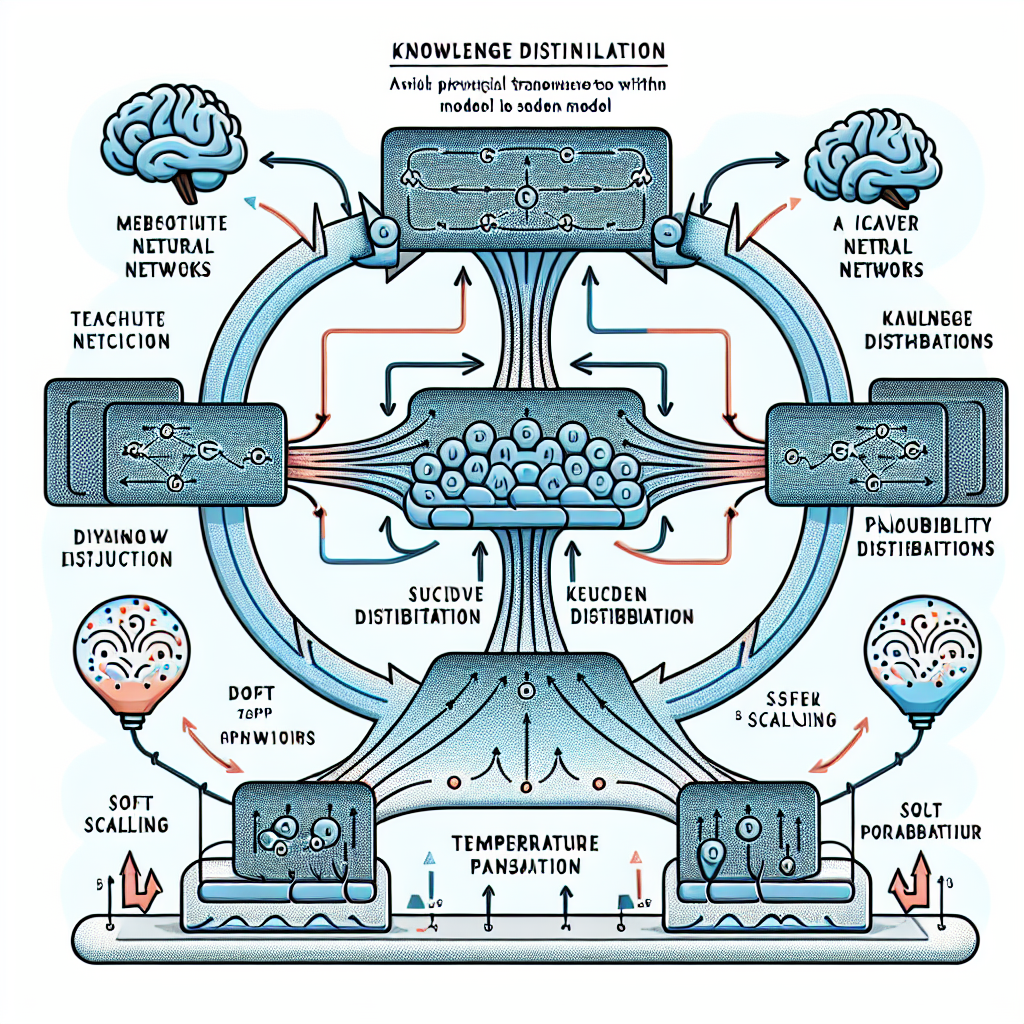

知識蒸留は、大規模な「教師」モデルが学習した知識を、小規模な「学生」モデルに移し替えるモデル圧縮技術です。従来のモデル訓練では、正解ラベル(0か1か、犬か猫か)だけを使いますが、知識蒸留では確率分布そのものを使います。たとえば「この画像は90%が犬、10%が猫」という微妙な判断情報まで学生モデルに伝えることで、より豊かな知識を小さなモデルに詰め込めるわけです。

今回公開された実装では、12個の教師モデルを組み合わせたアンサンブルを使っています。アンサンブルは複数のモデルの判断を平均することで高い精度を出せますが、実際のサービスで動かすには重すぎます。そこで、このアンサンブルが持つ知識を、パラメータ数わずか3,490個の学生モデルに圧縮する手法が示されました。

実装の仕組みと技術的な特徴

この実装パイプラインは、温度スケーリングという手法を使っています。温度パラメータを3.0に設定することで、モデルの出力確率を「柔らかく」します。通常、モデルは「99%が犬、1%が猫」のように極端な確率を出しがちですが、温度を上げると「70%が犬、30%が猫」のようになだらかになります。この滑らかな確率分布に、教師モデルが学んだパターンが含まれているのです。

訓練には組み合わせ損失関数を使います。KL発散という指標で教師の確率分布との類似度を測る「蒸留損失」を70%、正解ラベルとの一致度を測る「ハードラベル損失」を30%の割合で組み合わせます。さらに、KL発散には温度の二乗(T²)を掛けて再スケーリングすることで、訓練の安定性を保ちます。このあたりの設計は、論文の定石をきちんと押さえた実装になっています。

教師モデルのアーキテクチャは3層のニューラルネットワークで、256、128、64ユニットの隠れ層を持ちます。ドロップアウトで過学習を防ぎつつ、30エポックかけて訓練します。一方、学生モデルは64、32ユニットの2層構造とシンプルで、50エポックかけてじっくり教師の知識を吸収します。オプティマイザにはAdamを使い、学習率1e-3、重み減衰1e-4という標準的な設定です。

実際の性能はどうなのか

公開された結果によると、12モデルのアンサンブルは97.80%の精度を達成しました。これを蒸留した学生モデルは97.20%の精度で、わずか0.60ポイントの差に収まっています。一方、蒸留を使わずに正解ラベルだけで訓練したベースラインモデルは96.50%でした。つまり、蒸留によって0.70ポイント分の精度を回復できたことになります。

モデルサイズは劇的に縮小しています。アンサンブル全体と比較すると、学生モデルは160分の1のサイズです。これは、クラウドサービスのコスト削減やエッジデバイスでの推論を現実的にします。たとえば、スマートフォンアプリに組み込んだり、IoTセンサーで動かしたりする際に、この軽量性は大きな意味を持ちます。

ただし、0.60ポイントの精度ギャップは残ります。これは3,490パラメータという容量の限界で、教師が持つすべての知識を詰め込むことはできません。用途によっては、この精度差が許容できない場合もあるでしょう。医療診断や金融取引のように、わずかな誤差が大きな影響を及ぼす分野では、慎重な検証が必要です。

フリーランスのAIエンジニアにとっての意味

この技術は、クライアントに提供するAIモデルの選択肢を広げます。従来は「精度を取るか、速度を取るか」のトレードオフがありましたが、知識蒸留を使えば両立に近づけます。たとえば、画像認識アプリを開発する際、高精度なアンサンブルをローカル環境で訓練し、その知識を軽量な学生モデルに移してクライアントに納品する、という流れが可能です。

コスト面でも効果があります。クラウドでの推論コストは、モデルサイズに比例します。160分の1のサイズなら、月々のAPI料金やサーバー費用を大幅に削減できるでしょう。フリーランスとして、クライアントに「精度を維持しながらコストを下げられます」と提案できれば、競争力になります。

実装の難易度は中級レベルです。GitHubで公開されているコードはJupyter Notebook形式で、PyTorchとscikit-learnがあれば動かせます。教師モデルの訓練には時間がかかりますが、一度訓練すれば学生モデルの生成は比較的短時間で済みます。すでにPyTorchを使ったことがあるエンジニアなら、週末の実験で試せる範囲です。

この手法が特に役立つのは、NLPや音声認識、コンピュータビジョンなど、モデルサイズが問題になりやすい分野です。たとえば、チャットボットの応答速度を改善したい、音声アシスタントをスマートスピーカーに組み込みたい、といったケースで、知識蒸留は現実的な解決策になります。

今すぐ試すべきか、様子見か

すでにモデル圧縮や高速化の案件を抱えているエンジニアには、今すぐ試す価値があります。GitHubのコードはそのまま動くので、自分のデータセットに適用して効果を確認できます。特に、エッジデバイスやリアルタイム推論が求められるプロジェクトでは、この手法が解決の糸口になるかもしれません。

一方、まだモデル圧縮の必要性を感じていない場合は、様子見でも構いません。知識蒸留自体は新しい技術ではなく、2015年頃から研究されてきました。今回の実装は、それを実践的な形で公開したものです。将来、クライアントから「モデルを軽くしてほしい」と依頼されたときに、この手法を思い出せば十分です。

コメント