AIモデルの「配線」を変えて性能アップ

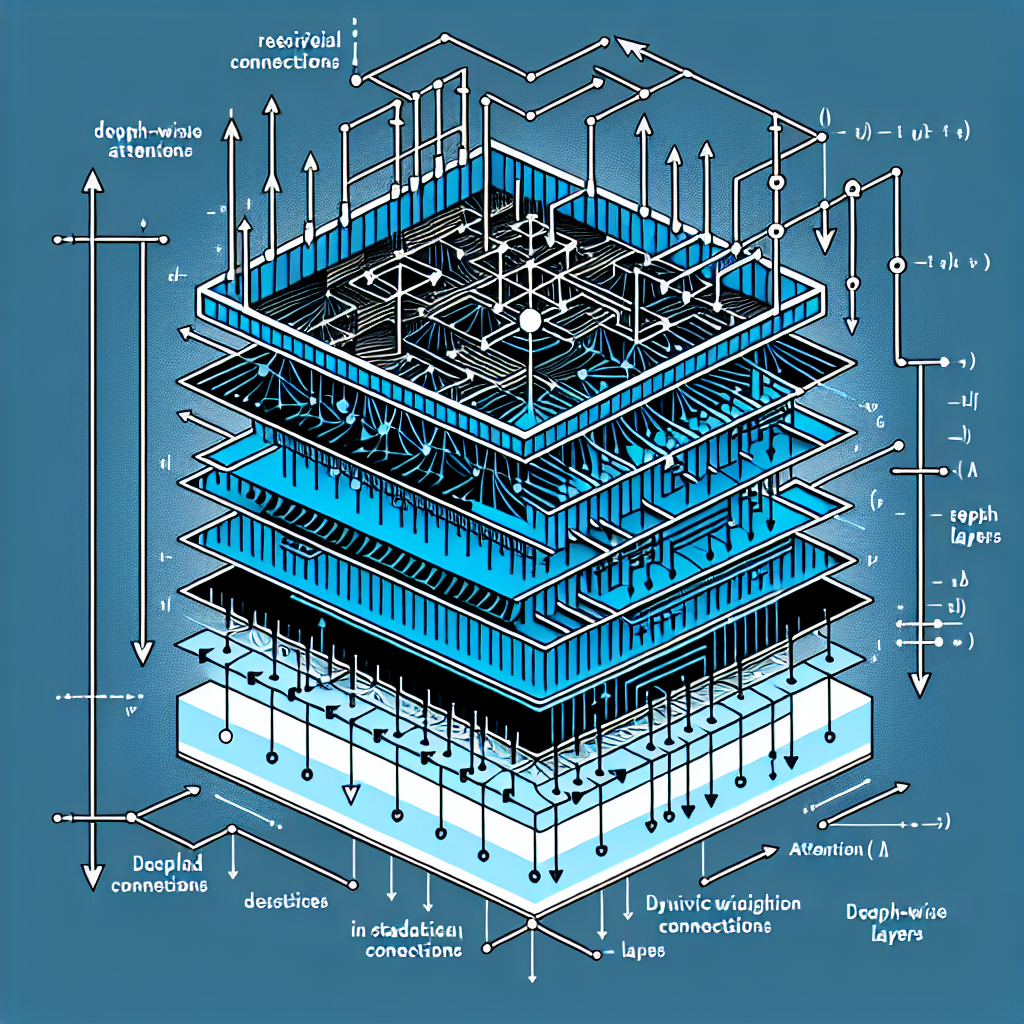

Transformerは、ChatGPTやClaudeなど、現在の主要なAIツールの基盤となっている技術です。この構造の中には「残差接続」という仕組みがあり、情報を層から層へと受け渡す役割を担っています。従来は、すべての層の出力を均等に足し合わせる単純な方法でしたが、Moonshot AIはこれを「Attention Residuals(AttnRes)」という新しい仕組みに置き換えました。

AttnResでは、各層が前の層の出力に対してAttentionという仕組みを使い、どの情報を重視するかを柔軟に選択できます。たとえば、文章を理解する際に、ある層は文法に関する情報を、別の層は意味に関する情報を重点的に参照する、といった具合です。これにより、モデル全体の判断精度が向上します。

従来の残差接続の3つの問題

研究チームは、標準的な残差接続には3つの課題があると指摘しています。1つ目は、すべての層が同じ情報の集まりを受け取るため、層ごとに必要な情報を選べないこと。2つ目は、情報が不可逆的に混ざってしまい、後の層が特定の前の情報を取り出せないこと。3つ目は、深い層になるほど出力が大きくなり、学習が不安定になる可能性があることです。

AttnResはこれらの問題に対処するため、各層が「擬似クエリベクトル」という学習可能なパラメータを使って、前の層の出力に重み付けをします。RMSNormという正規化技術も併用し、特定の層の出力が過度に影響力を持たないよう調整しています。初期化時にはゼロから始めることで、学習開始時は従来の残差接続と同じ状態からスタートし、徐々に最適な重み付けを学習していきます。

2つの実装方式:FullとBlock

AttnResには2つの実装方式があります。「Full AttnRes」は、すべての前の層に対してAttentionを適用する方式で、最も高い精度が得られますが、計算コストとメモリ使用量が大きくなります。一方「Block AttnRes」は、層をいくつかのブロックに分割し、ブロックの代表的な出力にのみAttentionを適用することで、コストを大幅に削減します。

Block AttnResは実用性を重視した設計で、パイプライン並列化(複数のGPUで学習する手法)でのオーバーヘッドは4%未満、推論時のレイテンシ増加は2%未満に抑えられています。これにより、大規模モデルの開発現場でも導入しやすくなっています。

スケーリング則での検証結果

研究チームは5つの異なるモデルサイズで性能を検証し、スケーリング則(モデルサイズと性能の関係を示す法則)を導き出しました。Block AttnResは、従来のベースラインと比較して、約1.25倍の計算量に相当する性能向上を達成しています。つまり、同じ計算資源でより良い結果が得られるということです。

実際のモデルでの改善効果

Moonshot AIは、自社の言語モデル「Kimi Linear」にAttnResを組み込んで実験しました。Kimi Linearは総パラメータ数48B、活性化パラメータ数3B、事前学習トークン数1.4TのMoE(Mixture of Experts)アーキテクチャを採用したモデルです。

複数のベンチマークテストでの結果は以下の通りです。MMLU(一般知識)が73.5から74.6に、GPQA-Diamond(科学的推論)が36.9から44.4に、BBH(困難な言語理解タスク)が76.3から78.0に向上しました。特に注目すべきは数学問題(Math)で53.5から57.1に、プログラミングテスト(HumanEval)で59.1から62.2に改善した点です。中国語のベンチマークでも、C-Evalが79.6から82.5に上がっています。

これらの改善は、各サイズグループで同じハイパーパラメータを使用した保守的な条件下での結果であり、AttnRes専用にチューニングすればさらなる向上が期待できます。効果の要因として、PreNorm希釈(正規化による情報の薄まり)の緩和、深さ方向での出力の安定化、層間の勾配のより均一な分散が挙げられています。

フリーランスへの影響

Attention Residualsは研究レベルの技術であり、フリーランスが直接操作するツールではありません。しかし、この技術が今後のAIモデルに組み込まれることで、私たちが日常的に使うツールの性能が向上する可能性があります。

特に影響が大きいのは、複雑な推論を必要とする作業です。数学的な計算やプログラミングの精度向上は、エンジニアやデータアナリストのフリーランスにとって、AIアシスタントの実用性が高まることを意味します。コード生成の精度が上がれば、修正作業の時間が減り、クライアントへの納品スピードも上がるでしょう。

ライティングやマーケティング分野でも、言語理解の精度向上は質の高い提案やアイデア出しにつながります。ただし、これらの恩恵を受けられるのは、各AI企業がこの技術を採用し、実装してからになります。現時点では、GitHubで公開されている研究成果の段階です。

コスト面では、Block AttnResの実装により推論時のオーバーヘッドが2%未満に抑えられているため、仮にこの技術が商用ツールに組み込まれても、大幅な料金上昇にはつながらないと考えられます。むしろ、同じ料金でより高性能なモデルが使えるようになる可能性があります。

まとめ

Attention Residualsは、AIモデルの基盤技術を改良する研究成果です。すぐに使えるツールではありませんが、今後数ヶ月から1年の間に、ChatGPTやClaude、Geminiなどの主要AIツールに同様の技術が組み込まれる可能性があります。フリーランスとしては、この技術動向を知識として持っておき、自分が使っているツールのアップデート情報に注目するのが良いでしょう。

興味のある方は、GitHubの公式リポジトリで技術的な詳細を確認できます。エンジニアであれば、実装コードを参照することで、最新のAI技術のトレンドを把握できるはずです。当面は様子見で問題ありませんが、今後の各社の製品発表には注目しておく価値があります。

参考リンク:

論文: https://github.com/MoonshotAI/Attention-Residuals/blob/master/Attention_Residuals.pdf

リポジトリ: https://github.com/MoonshotAI/Attention-Residuals/tree/master

コメント