AIが「使われながら学ぶ」時代へ

従来のAIトレーニングは、大量のデータを事前に集めて学習させる方式が一般的でした。しかしプリンストン大学が発表したOpenClaw-RLは、この常識を覆すアプローチを採用しています。ユーザーがAIエージェントと会話したり、コマンドを実行したり、GUIを操作したりする過程で得られるフィードバックを、そのままトレーニングデータとして活用します。

このフレームワークの特徴は、複数のインタラクション(会話、ターミナル操作、GUI操作、ツール呼び出し、ソフトウェア開発タスク)を同時に処理できる点です。研究者によれば、こうした異なる種類のやり取りを単一のトレーニングループで組み合わせるのは、今回が初めてとのこと。従来は各タスクごとに別々のシステムが必要でしたが、OpenClaw-RLはそれらを統合しています。

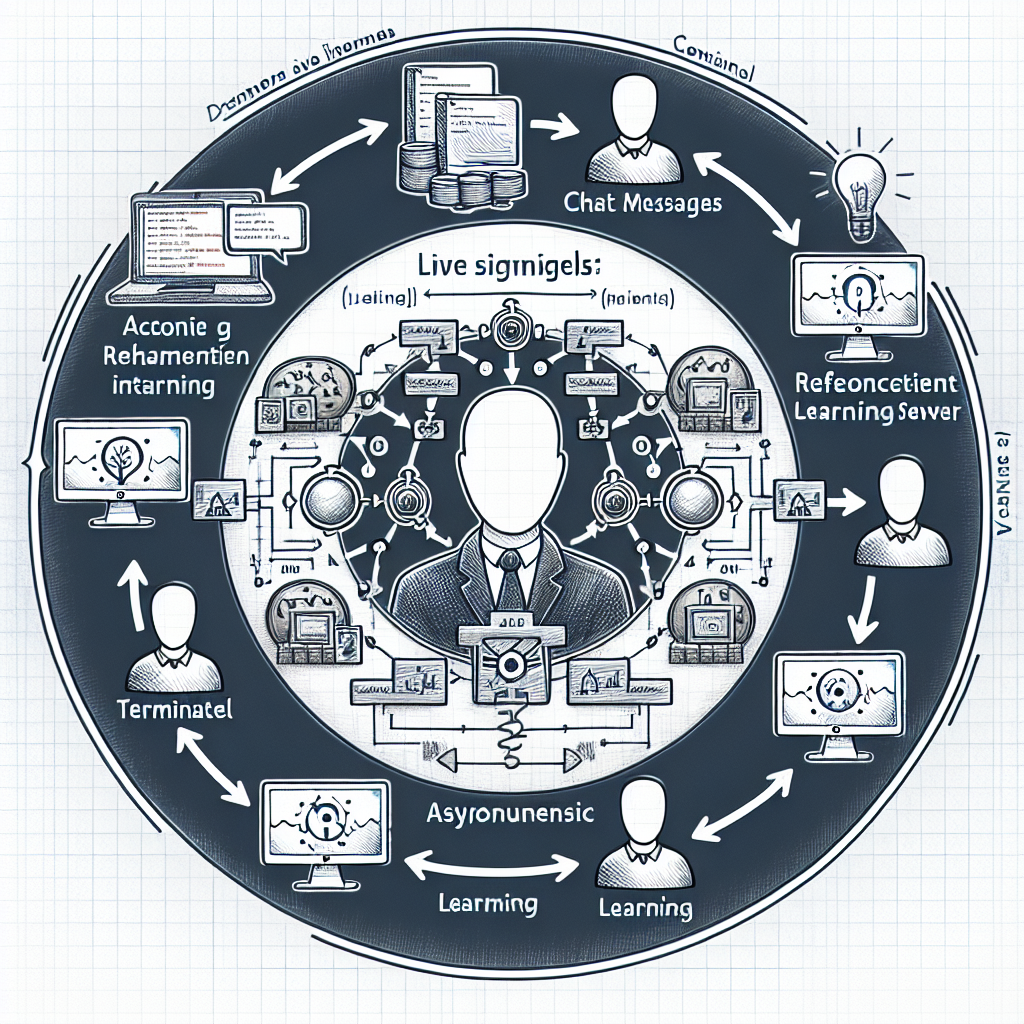

4つのモジュールが並列で動く仕組み

OpenClaw-RLは4つの独立したモジュールで構成されています。1つ目はモデルへのクエリ提供、2つ目は環境管理、3つ目は応答品質の評価、4つ目が実際のトレーニング実行です。重要なのは、これらが互いに待つことなく非同期で動作する点。たとえばあなたがAIと会話している間も、バックグラウンドでは別のモジュールが過去のやり取りを評価し、同時に別のモジュールがモデルの重みを更新しています。

トレーニング手法も独特です。OpenClaw-RLは2つの最適化手法を組み合わせています。1つ目は「Binary RL」と呼ばれる方法で、評価モデルが各アクションを「良い」「悪い」「中立」の3つに分類し、それを報酬として学習に反映させます。2つ目は「Hindsight-Guided On-Policy Distillation」という手法で、評価モデルがフィードバックから具体的な修正ヒント(1〜3文)を抽出し、元の質問に付け加えます。そして「ヒントがあったら、AIはどう答えていたか」を計算し、トークンレベルで方向性を示すというものです。

実際の性能はどうなのか

研究チームは、Qwen3-4Bという比較的小型のモデルを使って複数のシナリオでテストを行いました。特に興味深いのは「学生シナリオ」です。これはAI検出ツールに引っかからないように宿題をこなすという設定で、パーソナライゼーションスコア(どれだけその人らしい文章になったか)が、わずか8回のトレーニングステップで0.17から0.76へと大幅に向上しました。

もう1つの「教師シナリオ」では、生徒の宿題に具体的で友好的なフィードバックを返すという課題でした。こちらはスコアが0.22から0.90へと上昇。どちらのケースも、数十回程度のやり取りで顕著な改善が見られています。

汎用エージェント向けのテストでは、コマンドライン操作やGUI操作、ソフトウェアエンジニアリング、ツール呼び出しといった実務的なタスクで性能を測定しました。ツール呼び出しシナリオでは性能が0.17から0.30へ、ターミナルエージェントでは約0.17から約0.50(100ステップ後)へ、ソフトウェアエンジニアリングタスクでは0.05から0.18(35ステップ後)へと向上しています。劇的な数値ではありませんが、従来は不可能だった「使いながらの学習」が実現している点が重要です。

従来の手法との違い

これまでのAIシステムは、インタラクション後のフィードバックを次のアクションの参考情報として使うだけで、その後は破棄していました。また標準的な強化学習では、フィードバックを単一の数値(報酬)に圧縮するため、「どこをどう直せばいいか」という具体的な方向性が失われていました。OpenClaw-RLはこの問題を、具体的なヒントをトークンレベルで学習させることで解決しています。

さらに注目すべきは、別途ティーチャーモデルや事前収集データが不要という点です。従来の手法では、高性能なモデルに低性能なモデルを教えさせる「蒸留」や、大量のデータを事前に集める作業が必要でした。OpenClaw-RLは実際の利用シーンそのものがトレーニングデータになるため、そうした準備作業が不要です。

個人向けと汎用向けの2つの展開

OpenClaw-RLは2つの展開方法を想定しています。1つ目はパーソナルエージェント向けです。この場合、ユーザーのデバイスが機密APIを通じてトレーニングサーバーに接続し、重みの更新を中断なくシームレスに展開します。あなたのAIアシスタントが、あなたとの会話を通じてあなた専用に最適化されていくイメージです。

2つ目は汎用エージェント向けで、最大128の並列インスタンスでクラウドホスト環境にスケールできます。複数のユーザーからのフィードバックを集約し、より汎用的な性能向上を目指す使い方です。

フリーランスへの影響

現時点でこの技術を直接使って仕事を効率化できるかというと、正直なところまだ難しいでしょう。OpenClaw-RLはあくまで研究フレームワークであり、エンドユーザー向けのサービスではありません。プログラミングスキルがあり、AI開発に携わっているフリーランスエンジニアなら、GitHubからコードを取得して実験できますが、一般的なライターやデザイナーが今すぐ業務に活用するのは現実的ではありません。

ただし中長期的には、この技術が商用サービスに組み込まれる可能性があります。たとえばあなた専用にカスタマイズされたライティングアシスタントや、使えば使うほどあなたの好みを理解するデザインツールといった形です。特にパーソナライゼーションの性能向上は、フリーランスにとって魅力的です。クライアントごとに異なるトーンやスタイルを求められる仕事では、それぞれに最適化されたAIアシスタントがあれば作業時間を大幅に削減できるでしょう。

また、この研究は「AIは使われながら進化する」という方向性を示しています。今後登場するAIツールは、最初から完璧である必要がなくなり、ユーザーとのやり取りを通じて改善されていく形になるかもしれません。そうなれば、ツールを早めに導入して自分好みに育てた人が有利になる可能性があります。

OpenClawプロジェクトとの関係

少し紛らわしいのですが、このフレームワークは人気オープンソースAIエージェント「OpenClaw」の名称とインフラを使用しているものの、そのコアチームとは直接の関係を持たない独立した研究プロジェクトです。OpenClawの創設者Peter Steinbergerは、プロジェクトを財団に移管した後、次世代パーソナルAIエージェントの開発のためOpenAIに移籍しています。つまりプリンストン大学の研究とOpenAI側の動きが、どこかで交わる可能性もあるわけです。

まとめ

OpenClaw-RLは学術的には非常に興味深い成果ですが、フリーランスが今すぐ実務に取り入れるには技術的なハードルが高いでしょう。ただしこの技術の方向性、つまり「使いながら学ぶAI」という考え方は、今後の商用ツールに大きな影響を与える可能性があります。

今のところは様子見で問題ありませんが、AI開発に携わっている方や、将来的に自分専用のAIアシスタントを育てたいと考えている方は、GitHubで公開されているコードに目を通しておくと、今後のトレンドを先取りできるかもしれません。研究論文もarxiv.org/abs/2603.10165で公開されているので、技術的な詳細に興味がある方はそちらもチェックしてみてください。

コメント